Por Jorge Monastersky*

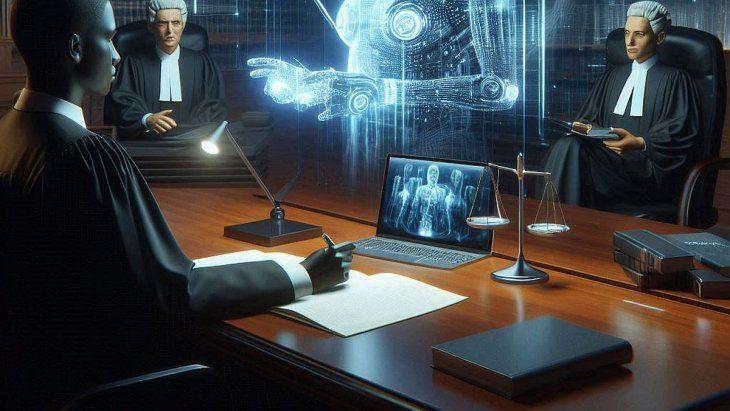

Inteligencia artificial, asesoramiento legal automatizado y crisis reputacional: un nuevo frente de riesgo para empresas y profesionales

La expansión de herramientas de IA capaces de ofrecer asesoramiento legal plantea interrogantes sobre responsabilidad profesional, calidad de la información y riesgos para la reputación corporativa en un entorno digital cada vez más expuesto.

-

Qué dice tu estación del año preferida de vos, según la IA

-

Cedears: empezó a cotizar en BYMA la empresa que voló más de 4.000% en Wall Street, ¿seguirá la suba?

La inteligencia artificial ya comenzó a aparecer en los tribunales. No solo como herramienta de apoyo para abogados o jueces, sino también como un elemento que empieza a influir directamente en conflictos legales reales. Ese fenómeno abre una discusión jurídica que probablemente marcará los próximos años en materia de regulación tecnológica y ejercicio profesional.

En marzo de 2026, la aseguradora Nippon Life Insurance Company of America presentó una demanda ante un tribunal federal del estado de Illinois contra OpenAI, la empresa detrás de ChatGPT. El planteo es inusual: sostiene que el sistema de inteligencia artificial habría intervenido en un conflicto legal brindando análisis jurídicos, generando argumentos y produciendo borradores de escritos que luego fueron utilizados dentro de un expediente judicial.

El caso plantea una pregunta que comienza a aparecer con mayor frecuencia en el ámbito jurídico: ¿hasta qué punto un sistema de inteligencia artificial puede participar en cuestiones legales sin incurrir en ejercicio ilegal de la abogacía?

El conflicto original era relativamente común. Una exempleada había iniciado un litigio contra la aseguradora por la cancelación de un beneficio por incapacidad laboral. El caso terminó con un acuerdo conciliatorio homologado por el tribunal, lo que implicaba el cierre definitivo del expediente.

Meses después, la demandante comenzó a cuestionar ese acuerdo. Según la demanda presentada por la empresa, utilizó ChatGPT para analizar el expediente, revisar la actuación de sus propios abogados y elaborar argumentos destinados a intentar reabrir el litigio.

La aseguradora sostiene que esa intervención generó un nuevo conflicto judicial que ya estaba cerrado y provocó más de 300.000 dólares en costos legales adicionales. Sobre esa base decidió demandar directamente a OpenAI.

Más allá del resultado que tenga este caso en particular, el debate ya comenzó a instalarse en distintas jurisdicciones. En el estado de Nueva York avanza un proyecto legislativo que busca limitar que sistemas de inteligencia artificial brinden asesoramiento profesional en áreas reguladas como el derecho o la medicina. En España, el Ilustre Colegio de la Abogacía de Madrid propuso incluso considerar como intrusismo profesional digital la prestación automatizada de asesoramiento jurídico.

Este debate no debería interpretarse como una discusión sobre prohibir la inteligencia artificial. Muy por el contrario, la tecnología ya forma parte del funcionamiento cotidiano de empresas, profesionales y organizaciones. El punto central no pasa por impedir su uso, sino por comprender sus límites, advertir los riesgos que puede generar cuando se utiliza de manera incorrecta y desarrollar criterios profesionales adecuados para integrarla de forma responsable.

La práctica jurídica no consiste solamente en citar normas o redactar documentos. Implica analizar hechos concretos, evaluar riesgos legales, diseñar estrategias procesales y asumir responsabilidad profesional por las decisiones adoptadas. Se trata de una actividad regulada que exige criterio profesional, independencia técnica y responsabilidad frente a las consecuencias de cada estrategia.

Las herramientas de inteligencia artificial pueden colaborar con investigación jurídica, organización de información o redacción preliminar de textos. Pero no pueden asumir responsabilidad profesional ni reemplazar el análisis estratégico que requiere la práctica del derecho.

Existe además un aspecto que muchas veces pasa inadvertido. Cuando una persona consulta a una inteligencia artificial sobre un problema legal, no existe secreto profesional. No hay relación abogado-cliente ni protección jurídica de confidencialidad.

En un reciente caso en Nueva York vinculado con una investigación por una presunta estafa superior a 300 millones de dólares, un tribunal dejó claro que las conversaciones con inteligencia artificial no están protegidas por el privilegio abogado-cliente.

Para empresas, ejecutivos y profesionales que utilizan estas herramientas para discutir asuntos sensibles, ese dato no es menor.

A medida que la inteligencia artificial comienza a integrarse en procesos corporativos, comunicación institucional y análisis de conflictos, también crece la preocupación por los riesgos legales y reputacionales que pueden derivarse de un uso inadecuado de estas tecnologías.

En los últimos tiempos se percibe un aumento sostenido del interés por analizar estos riesgos desde una perspectiva preventiva. Cada vez más organizaciones buscan revisar cómo se utilizan herramientas de inteligencia artificial dentro de sus procesos, qué implicancias jurídicas pueden surgir y de qué manera evitar que un problema técnico, una estrategia legal equivocada o una respuesta pública mal gestionada termine derivando en un conflicto judicial o en una crisis reputacional.

En ese contexto empieza a tomar relevancia un tipo de trabajo profesional que hasta hace pocos años era poco habitual: la revisión preventiva de riesgos legales y reputacionales vinculados al uso de inteligencia artificial. Muchas compañías prefieren hoy analizar escenarios posibles, revisar protocolos internos y anticipar conflictos antes de que una decisión tecnológica o comunicacional termine transformándose en un problema judicial o mediático.

Cuando ese análisis preventivo no existe, el escenario suele ser distinto. Una publicación que se viraliza, un documento generado por inteligencia artificial que se utiliza de manera incorrecta o una estrategia jurídica mal interpretada pueden escalar rápidamente. En esos casos, el manejo del conflicto exige algo más que una respuesta legal tradicional: requiere estrategia, comprensión del impacto público del caso y una gestión coordinada entre el plano jurídico y el reputacional.

La inteligencia artificial llegó para quedarse y su impacto en el derecho, la regulación tecnológica y la gestión de riesgos será cada vez más relevante.

Negar su utilidad sería un error. Pero asumir que puede reemplazar el criterio profesional también puede generar riesgos significativos para personas, empresas y organizaciones.

El desafío, en definitiva, no pasa por prohibir estas herramientas, sino por comprender sus límites y utilizarlas dentro de marcos jurídicos y estratégicos adecuados.

En un contexto donde se cruzan inteligencia artificial, derecho, reputación y gestión de conflictos, la prevención, el análisis estratégico y el criterio profesional siguen siendo elementos centrales.

*El autor es abogado, Doctor en Ciencias Jurídicas y Sociales y Posgrado en Derecho Procesal Penal Profundizado