El 30 de noviembre de 2022 se lanzó oficialmente ChatGPT. Y es cierto que, al menos en su inicio, pocos tomaron conciencia del impacto que podría traer en los distintos aspectos de la vida cotidiana, mucho menos las organizaciones.

ChatGPT: ¿un nuevo riesgo para los auditores?

Somos conscientes de que esta tecnología disruptiva se podría incorporar sin ningún tipo de problemas. Pero a partir que las empresas comienzan a incorporar esta tecnología con sus "ventajas", surgirán con ellas ciertos "riesgos".

-

Así es Chat GPT-5.5 Instant, un modelo que promete menos errores y respuestas más contextualizadas

-

Cómo fue la salida de Elon Musk de OpenAI, según Greg Brockman

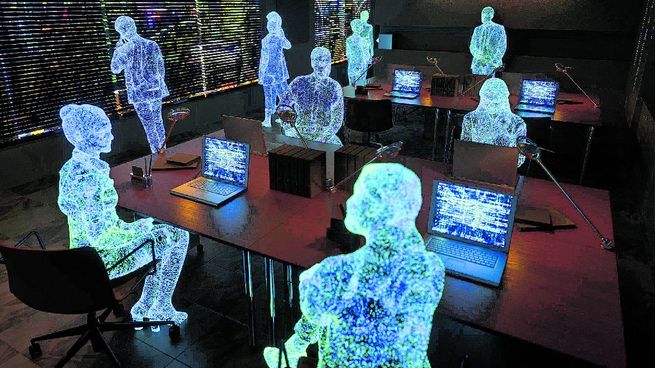

Según su definición, ChatGPT es un Bot conversacional desarrollado a través de inteligencia artificial que tiene la capacidad de estructurar respuestas y textos de una forma que, en muchos casos, se hace difícil poder determinar si la respuesta ha sido realizada por un humano o por el propio sistema.

El origen de esta capacidad es, en primer término, la utilización de grandes volúmenes de texto para que el sistema se entrene y así poder realizar tareas de procesamiento de lenguaje natural: entendiéndolo como el lenguaje o idioma, hablado o escrito, por los humanos para propósitos normales de comunicación.

El segundo aspecto es utilizar el aprendizaje supervisado o de refuerzo, pues consistirá en que los humanos den una retroalimentación a los fines de lograr un proceso de mejora continua.

Como resultado final de esta “operación”, disponemos de un chatbot con la capacidad de procesar texto en lenguaje natural generando un material coherente, con una apropiada estructura semántica. En resumen, uno que estará correctamente escrito y que perfectamente podría ser pensado y luego redactado por un humano.

Toda Disrupción trae beneficios y también riesgos

En función a lo que hemos descripto anteriormente, somos conscientes de que esta tecnología disruptiva se podría incorporar sin ningún tipo de problemas: actividades diarias y con un uso particular, ayudándonos a crear escritos, publicaciones, colaborando en nuestras consultas de investigación… pero también para el uso empresarial, desde la utilización del chatbot de alto nivel hasta ser un asesor de consulta para tareas diarias e inquietudes que pueda tener un empleado. Además, por supuesto, de muchas otras ventajas que aún faltan por descubrir.

A partir que las empresas comienzan a incorporar esta tecnología con sus “ventajas”, surgirán con ellas ciertos “riesgos” que, en este caso, un Auditor Interno o bien uno Externo de una organización deberá tener en cuenta: riesgos que pueden afectar de forma significativa a la organización.

A continuación, una serie de riesgos que han salido a la luz que como Auditores ya deberemos considerar:

- Confidencialidad de la Información: Como dijimos, ChatGPT utiliza un gran volumen de datos para entrenarse, así como resguarda información de todas las conversaciones y consultas que se realizaron en su plataforma. En este sentido, a finales de marzo, oímos la noticia que llegó desde Europa. Resulta que el gobierno de Italia bloqueó la utilización de ChatGPT para los ciudadanos, básicamente por dos cuestiones: no respetar la legislación de datos personales (recordemos que Europa tiene uno de los Reglamentos Generales de Protección de Datos – RGPD – más completos del mundo) y adicionalmente carecer de un sistema de verificación de edades para usuarios menores;

- El incidente Samsung: Para mediados de abril se conocía la noticia de que empleados de Samsung habían filtrado información sensible al utilizar ChatGPT. Lo cierto es que buscaban reducir sus tareas y suministraron información sensitiva para crear resúmenes de su trabajo o encontrar errores, pero no tuvieron en consideración que el sistema se entrena con los datos que son ingresados… esto significa que la información compartida actualmente está en poder de los servidores de OpenAI y que otros usuarios en algún tipo de consulta específica podrían recibir como respuesta esta información-;

- Cuando OpenGPT miente: En un artículo del 5 de abril, el diario Washington Post presentaba una nota sobre la posibilidad que ChatGPT ante una consulta, por ejemplo pedir datos biográficos de una persona, pueda inventar información (en este caso particular ChatGPT asoció a una persona con un escándalo sexual), pero lo peor es que la expuso en base a fuentes que en sí eran falsas. Parece que, como tantos otros, la IA cayó en las detestables e inagotables Fake News.

Como vemos, estos son algunos incidentes que han salido a la luz, y puede que con el tiempo surjan más. Esto no inhabilita el uso de una tecnología tan relevante en cualquier organización pero si implica tomar los recaudos necesarios teniendo en cuenta que es una tecnología aún en pleno desarrollo.

Desde la óptica de los auditores; ChatGPT nos exige ser cautelosos, utilizar el escepticismo profesional, capacitarnos en la herramienta y estar atentos a cualquier nuevo riesgo que pueda surgir.

Docente de la carrera de Contador Público y Administración de Empresas (UADE).