La inteligencia artificial es uno de los avances tecnológicos que más revolucionó el mundo en el último tiempo. Sin embargo, muchos advierten de los peligros que puede tener un progreso tan desmedido de una herramienta de tanto alcance. En ese sentido, algunos expertos de Estados Unidos señalaron que puede llevar a la humanidad a la "extinción".

Inteligencia Artificial: advierten que puede llevar a la "extinción" a la humanidad

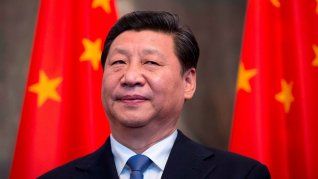

El Centro para la Seguridad de la IA publicó una declaración firmada por casi 400 expertos, entre ellos Sam Altman, CEO de OpenAI, la compañía detrás de ChatGPT, donde advitieron los peligros de la revolucionaria tecnología.

-

Inteligencia Artificial: 9 herramientas imperdibles que facilitarán tu día a día

-

Google Maps sumará Inteligencia Artificial para explorar en tiempo real: de qué trata

La Inteligencia Artificial preocupa a los expertos.

Casi 400 de los nombres más importantes en el mundo de la Inteligencia Artificial lanzaron una declaración conjunta en la web del Centro para la Seguridad de la IA donde expresaron: "Mitigar el riesgo de extinción por IA debería ser una prioridad global junto con otros riesgos a escala social, como las pandemias y la guerra nuclear".

Sam Altman, CEO de OpenAI, la compañía detrás de ChatGPT, fue uno de los que firmó el comunicado al igual que los principales ejecutivos de IA de Google y Microsoft, además de 200 académicos.

Meredith Whittaker, presidenta de la aplicación de mensajería cifrada Signal y asesora principal del AI Now Institute, un grupo sin fines de lucro dedicado a las prácticas éticas de IA, se burló de la declaración y la rechazó por completo.

Clément Delangue, cofundador y CEO de la empresa de IA Hugging Face, tuiteó una foto de una versión editada de la declaración subscribiéndola en "AGI" para la IA.

AGI significa inteligencia general artificial, que es una forma teórica de IA que es tan capaz o más capaz que los humanos. La declaración se produce dos meses después de que un grupo diferente de líderes de IA y tecnología, incluido el propietario de Tesla, Elon Musk, el cofundador de Apple, Steve Wozniak, y el científico jefe de IBM, Grady Booch, firmaran una petición pidiendo una "pausa" en toda la investigación de IA a gran escala.

Ninguno de ellos firmó todavía la nueva declaración, y no se produjo tal pausa.

¿Cuáles son las tres etapas de la IA?

Las tecnologías de IA se clasifican por su capacidad para imitar las características humanas.

1) Inteligencia artificial estrecha (ANI)

La categoría más básica de IA es más conocida por sus siglas en inglés: ANI, por Artificial Narrow Intelligence. Se llama así porque se enfoca en una sola tarea, entrenándose con datos de Internet y tomando decisiones o realizando acciones basadas en ese entrenamiento.

Una ANI puede igualar o superar a la inteligencia y eficiencia humana pero solo en esa área específica en la que opera. No tienen autoconciencia, por lo que también se la conoce como “IA débil”. Actualmente, la IA que se puede utilizar está en este nivel.

2) Inteligencia artificial general (AGI)

Esta categoría se alcanza cuando una máquina adquiere capacidades cognitivas a nivel humano, y puede realizar cualquier tarea intelectual que realiza una persona. Conocida como “IA fuerte”, se cree que la tecnología desarrollada está a punto de llegar a este nivel.

3) Súper Inteligencia Artificial (ASI)

Cuando se alcanza este nivel, la inteligencia sintética supera a la humana. Según las teorías, cuando una máquina logre tener una inteligencia a la par con la humana, su capacidad de multiplicar esa inteligencia de forma exponencial a través de su propio aprendizaje autónomo hará que en poco tiempo supere al hombre ampliamente.

Este estadio preocupa a los especialistas, ya que implicaría una evolución de las máquinas superior al de los humanos. A una inteligencia mayor, las probabilidades de poner manejarlo se vuelven menores.

- Temas

- Inteligencia Artificial

Dejá tu comentario