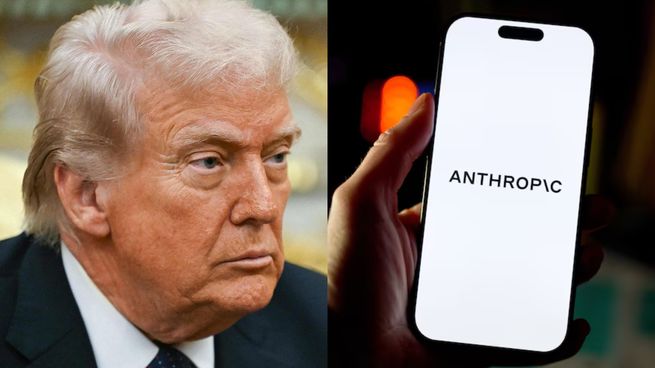

El Pentágono utilizó la inteligencia artificial Claude en el ataque aéreo contra Irán apenas horas después de que el presidente Donald Trump ordenara a las agencias federales dejar de usar esa tecnología. La decisión profundizó la tensión entre la Casa Blanca y la empresa Anthropic en medio de la ofensiva militar.

El Pentágono usó la inteligencia artificial de Claude en el ataque a Irán horas después de que Donald Trump ordenara prohibirla

La tecnología de Anthropic habría sido empleada para inteligencia y selección de objetivos, pese a que el presidente dispuso dejar de utilizarla.

-

El gobierno aguarda por la comunicación oficial de los aranceles de Trump y cuestiona la medida

-

Trump mostró signos de somnolencia durante un encuentro en la Casa Blanca

Claude, la IA de Anthropic, habría sido utilizada para inteligencia y selección de objetivos en Irán.

Medios como The Wall Street Journal y Axios informaron que oficiales militares estadounidenses emplearon herramientas desarrolladas por Anthropic con fines de inteligencia, identificación de objetivos y simulación de escenarios de batalla. El uso se produjo pese a que la compañía había rechazado públicamente que su modelo fuera utilizado para vigilancia doméstica masiva o en sistemas de armas totalmente autónomos.

El contrato millonario entre Anthropic y el Departamento de Defensa

Anthropic había firmado en julio del año pasado un contrato por u$s200 millones con el Departamento de Defensa para desarrollar “prototipos de capacidades de IA de vanguardia que impulsen la seguridad nacional de EEUU”, según detalló la propia empresa en su sitio oficial.

En las últimas semanas, el Pentágono solicitó acceso a la herramienta para “todo uso legal”. La compañía aceptó, pero estableció dos límites: que no se empleara para vigilancia doméstica masiva ni para la implementación en armas autónomas. En ese marco, el comunicado de la empresa sostuvo: “Apoyamos el uso de IA para misiones legales de inteligencia y contrainteligencia extranjeras. Sin embargo, usar estos sistemas para la vigilancia doméstica masiva es incompatible con los valores democráticos”.

También advirtió: “Hoy en día, los sistemas de IA de vanguardia simplemente no son lo suficientemente fiables como para impulsar armas totalmente autónomas. No proporcionaremos, a sabiendas, un producto que ponga en riesgo a los combatientes y civiles estadounidenses”.

El ultimátum, la ruptura y los ataques

Según detalló CNBC, el Departamento de Defensa fijó como plazo límite las 5:01 p.m. ET del viernes para que Anthropic aceptara el acceso total. Tras vencerse ese plazo, Trump calificó a la empresa como una “empresa de IA de izquierda radical” y ordenó iniciar un proceso de eliminación gradual de sus productos en las agencias federales.

El secretario de Defensa, Pete Hegseth, escribió en X: “La postura de Anthropic es fundamentalmente incompatible con los principios estadounidenses. Por lo tanto, su relación con las Fuerzas Armadas de Estados Unidos y el Gobierno Federal ha cambiado para siempre”.

Sin embargo, pocas horas después de esas declaraciones, se produjeron los ataques de Estados Unidos e Israel contra Irán y la misma tecnología habría sido utilizada por comandos en distintas regiones, incluido el Mando Central de EEUU (CENTCOM), para evaluaciones estratégicas.

Trump aclaró que la prohibición tendría una transición progresiva: “Habrá un período de eliminación gradual de seis meses para Agencias como el Departamento de Guerra que estén utilizando los productos de Anthropic, en varios niveles”.

Antecedentes y nuevos acuerdos

No sería la primera vez que la IA de Anthropic aparece vinculada a operaciones sensibles. A mediados de febrero, distintos medios señalaron que la herramienta habría sido utilizada en la operación de captura de Nicolás Maduro, lo que generó fricciones internas en la compañía debido a sus propias restricciones sobre violencia y armas.

Tras la ruptura con Anthropic, el Departamento de Defensa avanzó en acuerdos con competidores como OpenAI y xAI, la firma de Elon Musk. OpenAI confirmó el entendimiento y explicó: “Ayer llegamos a un acuerdo con el Pentágono para desplegar sistemas avanzados de IA en entornos clasificados, y solicitamos que también los pongan a disposición de todas las empresas de IA”.

La empresa añadió que su tecnología no se utilizará para vigilancia doméstica masiva, sistemas de armas autónomos ni decisiones automatizadas de alto riesgo.