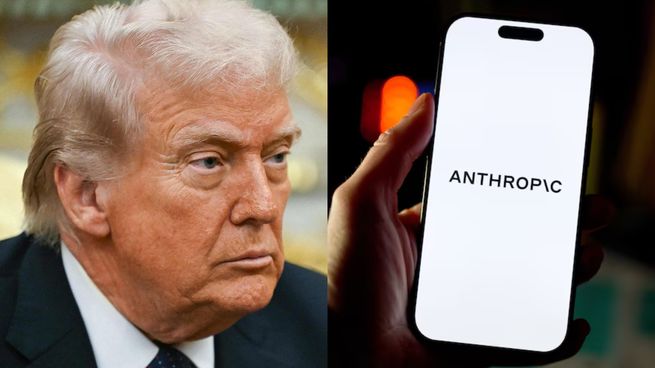

Tras días de tensión y debate público, el Pentágono clasificó a Anthropic- desarrollador del modelo Claude - como un "riesgo para la cadena de suministro". La decisión llegó en un escenario de fuerte enfrentamiento entre el presidente Donald Trump y el director de la empresa, Dario Amodei, por los límites impuestos en el uso de esta tecnología para desarrollar armas autónomas y avanzar en sistemas de vigilancia masiva.

El Pentágono catalogó a Anthropic como "riesgo para la cadena de suministro"

La decisión de Donald Trump marca una postura inédita contra una empresa de Silicon Valley. En medio del debate público, OpenAI se coló y será el nuevo proveedor del Defensa de Estados Unidos (DOD, por sus siglas en inglés).

-

Qué dijo Trump cuando le preguntaron si atacaría Irán con bombas nucleares

-

Trump confirmó que Israel y Líbano extenderán tres semanas el alto el fuego

Trump da un golpe sobre la mesa en su batalla con Anthropic.

¿Qué consecuencias trae la etiqueta de "riesgo para la cadena de suministro"? La designación formal establece - de manera inmediata - una prohibición sobre los contratistas del gobierno para utilizar tecnología Anthropic en su trabajo para el ejército estadounidense.

La batalla entre Anthropic y Donald Trump suma un nuevo capítulo

Trump decidió ir a fondo en una nueva disputa de poder en Estados Unidos. La clasificación es histórica para una empresa de Silicon Valley ya que coloca ahora a Anthropic en una categoría que Washington había reservado principalmente para actores extranjeros considerados sensibles desde el punto de vista estratégico. Una medida similar, por ejemplo, fue utilizada anteriormente para excluir al gigante tecnológico chino Huawei de las cadenas de suministro del Departamento de Defensa.

Las empresas que trabajan con el modelo de inteligencia artificial Claude, desarrollado por Anthropic, podrán seguir utilizándolo en proyectos que no estén vinculados al Departamento de Defensa de Estados Unidos. Así lo aclaró el director ejecutivo de la compañía, Dario Amodei, al explicar que la reciente designación impuesta por Washington tiene un alcance acotado.

"Se aplica claramente solo al uso de Claude por parte de los clientes como parte directa de los contratos con el Departamento de Guerra, no a todo el uso de Claude por parte de los clientes que tienen dichos contratos", aseguró Amodei.

La clasificación de riesgo surgió luego de un prolongado desacuerdo entre la empresa y el Departamento de Defensa —denominado por el Gobierno de Donald Trump como Departamento de Guerra— respecto de las condiciones bajo las cuales el ejército puede utilizar sistemas de inteligencia artificial.

Negociaciones cruzadas y tensiones públicas

En los últimos días, representantes de Anthropic y del Pentágono discutieron posibles alternativas para que el Departamento de Defensa deje de utilizar Claude, según explicó Amodei. También evaluaron escenarios que permitan continuar colaborando sin que la empresa tenga que desmantelar las salvaguardias que impuso sobre el uso militar de su tecnología.

Sin embargo, la versión fue rápidamente desmentida desde Washington. En una publicación en la red social X el jueves por la noche, el director de tecnología del Pentágono, Emil Michael, afirmó que actualmente no existe ninguna negociación activa con la compañía.

Amodei incluso debió disculparse por una nota interna que el sitio especializado The Information publicó el miércoles. En ese documento, redactado originalmente el viernes anterior, el ejecutivo señalaba que a algunos líderes del Pentágono no les agradaba la empresa, en parte porque "no hemos elogiado a Trump al estilo de un dictador".

La difusión de ese mensaje interno coincidió con los esfuerzos de los inversores de Anthropic por contener el impacto reputacional tras la ruptura con el Departamento de Defensa.

Paradójicamente, el Departamento de Defensa continúa utilizando tecnología de la compañía para diversas operaciones militares, incluidas actividades relacionadas con Irán, según indicó una fuente cercana al tema. Entre otros usos, Claude podría estar siendo empleado para analizar información de inteligencia y asistir en la planificación operativa.

El impacto en el sector tecnológico

Desde el sector tecnológico, el impacto de la medida parece limitado. Un portavoz de Microsoft señaló que la compañía revisó la designación y concluyó que los productos de Anthropic seguirán disponibles para la mayoría de los clientes.

"Los productos de Anthropic, incluido Claude, pueden seguir estando disponibles para nuestros clientes, excepto para el Departamento de Guerra, a través de plataformas como M365, GitHub y Microsoft AI Foundry", afirmaron desde Microsoft, que remarcó que continuará colaborando con Anthropic en proyectos que no estén vinculados con la defensa.

El debate también alcanza al ecosistema de defensa tecnológica. La plataforma Maven Smart Systems de Palantir, utilizada por fuerzas armadas para análisis de inteligencia y selección de objetivos, emplea flujos de trabajo construidos sobre código de Claude, según reportó previamente Reuters.

La respuesta de Anthropic

El director ejecutivo de Anthropic, Dario Amodei, anunció el jueves que la empresa planea impugnar ante la justicia la decisión del Departamento de Defensa de Estados Unidos de clasificar a la compañía de inteligencia artificial como un riesgo para la cadena de suministro. El ejecutivo calificó la medida como una decisión “legalmente errónea”.

La reacción de Anthropic llegó pocas horas después de que el Pentágono formalizara la designación, tras varias semanas de tensiones en torno al grado de control que las fuerzas armadas deberían tener sobre los sistemas de inteligencia artificial desarrollados por la empresa. Este tipo de clasificación puede impedir que una compañía colabore directamente con el Departamento de Defensa y con su red de contratistas.

En el centro de la disputa aparece el uso militar de la tecnología. Amodei reiteró que Anthropic no permitirá que su modelo de IA sea utilizado para vigilancia masiva sobre ciudadanos estadounidenses ni para el desarrollo de armas totalmente autónomas.

En su comunicado, Amodei también adelantó parte de los argumentos que la empresa podría presentar en los tribunales. Según sostuvo, la carta del Departamento de Defensa que clasifica a Anthropic como riesgo para la cadena de suministro tiene un alcance limitado y no debería interpretarse como una sanción general contra la empresa.

“Existe para proteger al gobierno, no para sancionar a un proveedor; de hecho, la ley exige que el Secretario de Guerra utilice los medios menos restrictivos necesarios para lograr el objetivo de proteger la cadena de suministro”, afirmó. Y agregó: “Incluso para los contratistas del Departamento de Guerra, la designación de riesgo de la cadena de suministro no limita (ni puede limitar) el uso de Claude ni las relaciones comerciales con Anthropic si no están relacionadas con sus contratos específicos con el Departamento de Guerra”.

El director ejecutivo también subrayó que la prioridad de la compañía es garantizar que los militares estadounidenses y los expertos en seguridad nacional mantengan acceso a herramientas tecnológicas clave en medio de operaciones en curso. Actualmente, Anthropic colabora con ciertas actividades estadounidenses vinculadas a Irán, y Amodei aseguró que la empresa seguirá proporcionando sus modelos al Departamento de Defensa a un precio nominal mientras se gestiona la transición.

Aun así, el camino judicial no será sencillo. Anthropic podría presentar su impugnación en un tribunal federal —probablemente en Washington—, pero la legislación que respalda este tipo de decisiones limita los mecanismos habituales con los que las empresas pueden cuestionar compras o contrataciones del gobierno. Además, otorga al Pentágono amplias facultades cuando se trata de cuestiones vinculadas a la seguridad nacional.

Dejá tu comentario